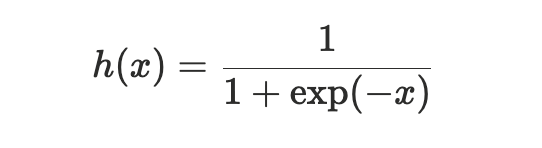

Day05. 시그모이드 함수

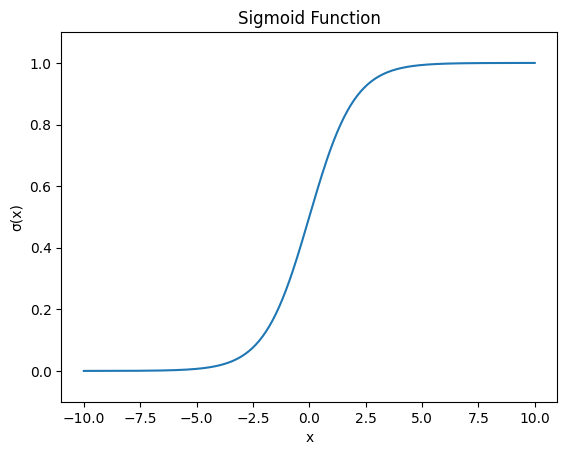

- 신경망에서 자주 이용하는 활성화 함수

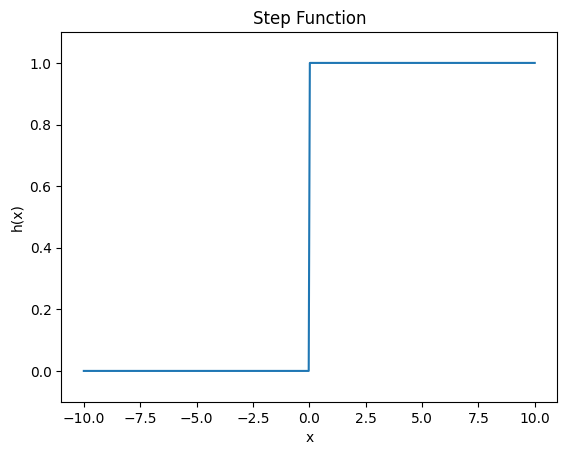

- 퍼셉트론의 계단 함수는 0과 1 만을 리턴 한다

- 하지만 시그모이드 함수는 0과 1 사이의 연속값을 출력 한다

- 그래서 확률처럼 해석 가능

- 위 두 개의 함수는 모두 비선형 함수

- 선형 함수는 위 그래프가 1 줄로 그려짐

- 신경망에서는 활성화 함수로 비선형 함수를 사용해야 함

- 선형 함수를 사용하면 신경망의 층을 깊게 하는 의미가 없어짐

- 선형 함수는 은닉층이 없는 네트워크로도 똑같은 기능을 할 수 있게 됨

- 수학적으로 단순화 할 수 있는데, 그럼 은닉층이 사라짐

- 선형 함수를 사용하면 신경망의 층을 깊게 하는 의미가 없어짐